Reporting a Power BI

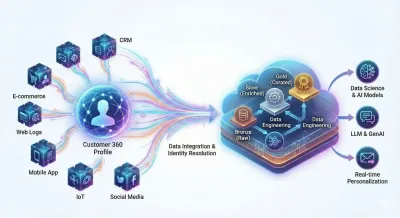

Customer 360

Vytvoření unifikovaného Customer 360 profilu není jen marketingový cíl, ale komplexní architektonická výzva. Tento článek analyzuje nezbytný přechod na architekturu Data Lakehouse v ekosystému Microsoft Fabric a Azure. Zjistěte, jak vybudovat moderní datovou platformu, která slouží jako robustní základna pro pokročilou cloudovou analytiku a hyper-personalizaci komunikace s využitím AI a LLM.

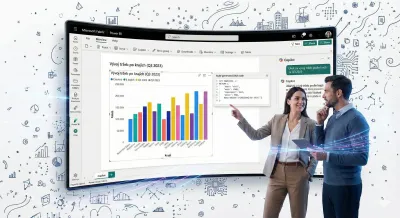

Copilot v Microsoft Fabric a Power BI

Copilot v Microsoft Fabric a Power BI zásadně mění způsob, jakým firmy pracují s daty. Díky generování reportů, analýz a DAX výpočtů pomocí přirozeného jazyka se analytika přibližuje business uživatelům a zrychluje cestu od otázky k rozhodnutí. Článek ukazuje praktické využití Copilota, jeho přínos pro moderní datovou platformu i limity, na které je nutné myslet z pohledu datové architektury a governance.

ROI datových projektů

Datové projekty často selhávají ne proto, že by nefungovala technologie, ale protože není měřený a vlastněný jejich reálný byznysový dopad – podle Gartnera se jen 20 % analytických insightů promítne do konkrétní akce. Tento článek ukazuje, jak od začátku nastavit cíle a KPI, změřit výchozí stav (baseline), průběžně validovat přínosy a vyhnout se typickým pastem, jako je technologické „řešení bez adopce“, špatná interpretace dat nebo nerealistická očekávání.

Tvorba dashboardů v Power BI

Dashboard v Power BI má smysl tehdy, když uživateli během pár vteřin ukáže stav klíčových KPI a zároveň mu umožní rychle dohledat příčinu změn pomocí filtrů, drill-through a dalších interakcí. V článku shrnujeme praktické zásady přehledné datové vizualizace, doporučenou strukturu reportů pro management a typické chyby, kterým se vyhnout. Nechybí ani pohled na „backend“ – jak dashboard zapadá do firemní datové platformy na Azure (Azure SQL, Data Factory, Data Lake/Microsoft Fabric), a jak správně řešit publikaci, sdílení a zabezpečení v Power BI Service.

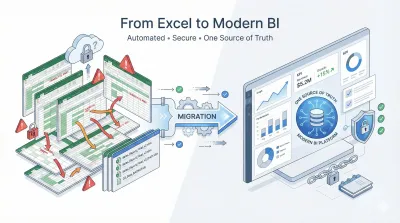

Migrace z Excelu do moderního BI

Excel je skvělý nástroj pro ad-hoc analýzy, ale v roli firemního reportingu rychle narazí na limity: chybovost, neaktuálnost, problémy s verzemi i bezpečnostní rizika. Článek popisuje, jak přejít od manuálních tabulek k modernímu BI tak, aby vznikla „jedna verze pravdy“, automatizované datové toky a řízený přístup k datům. Získáte praktickou metodiku migrace od auditu Excelů přes návrh datového modelu až po řízené přepnutí a adopci uživatelů.

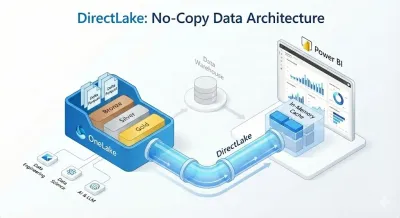

DirectLake v Power BI – přímý přístup k datům bez duplikace

DirectLake posouvá Power BI do bodu, kdy už nemusíte dělat bolestivý kompromis mezi rychlostí importu a aktuálností DirectQuery. Data se čtou přímo z OneLake v Microsoft Fabricu, bez zbytečné duplikace do datového modelu a bez dlouhých plánovaných refreshů, které často brzdí práci s velkými datasety. Výsledkem je interaktivita blízká import módu, ale s výrazně čerstvějšími daty a jednodušší architekturou „jednoho zdroje pravdy“. V článku si vysvětlíme, jak DirectLake technicky funguje nad Delta tabulkami, kde typicky přináší největší výkonový a nákladový efekt a jak se liší od DirectQuery z pohledu latence, zátěže infrastruktury i provozních rizik v enterprise prostředí.